एआईका कारण के मानवजाति मासिन सक्छ ?

काठमाडौं । ओपनएआई र गुगल डीपमाइन्डका प्रमुखहरूसहित केही विज्ञहरूले आर्टिफिशल इन्टेलिजन्स (एआई) का कारण मानवजाति लोप हुन सक्ने चेतावनी दिएका छन् । उपकरणहरूले मानिसलाई विस्थापित गर्ने अवस्थासँग हामी कति नजिक छौँ त ?

एआईको प्रयोग गरेर प्रश्नहरूको उत्तर दिन वा प्रयोगकर्ताहरूको मागअनुसार लेख वा कोड सिर्जना गर्न प्रयोग हुने च्याटबट ‘च्याटजीपीटी’ सन् २०२२ को नोभेम्बरमा सञ्चालनमा आएदेखि इतिहासमै सबैभन्दा तीव्र रूपमा प्रयोगकर्ताहरू बढेको एप्लिकेशन बनेको छ ।

दुई महिनामा यसका सक्रिय प्रयोगकर्ता १० करोड पुगेका छन् ।

प्रविधि अनुगमन गर्ने कम्पनी सेन्सर टाउनका अनुसार इन्स्टाग्रामलाई सोही सङ्ख्यामा प्रयोगकर्ता हासिल गर्न साढे दुई वर्ष लागेको थियो ।

माइक्रोसफ्टको आर्थिक सहयोगमा ओपनएआई कम्पनीद्वारा विकसित च्याटजीपीटीको व्यापक लोकप्रियतापछि मानवजातिको भविष्यबारे आर्टिफिशल इन्टेलिजन्सको प्रभावबारे विभिन्न आकलन हुन थालेको छ ।

दर्जनौँ विज्ञहरूले ‘सेन्टर फोर एआई सेफ्टी’को वेबपेजमा प्रकाशित एक विवरणमा सहमति जनाउँदै भनेका छन्, ‘एआईका कारण लोप हुने जोखिम न्यूनीकरण गर्नु महामारी र पारमाणविक युद्धजस्ता अन्य सामाजिक स्तरका जोखिमहरू कम गर्नु सरह विश्वव्यापी प्राथमिकता हुनुपर्छ ।’

यद्यपि अन्य केहीले भने यसबारे आवश्यकताभन्दा बढी डर फैलिएको टिप्पणी गरेका छन् ।

मान्छेको नक्कल

च्याटजीपीटी, डाल-ई, बार्ड र अल्फाकोडजस्ता एआई प्रयुक्त सफ्टवेअरद्वारा सिर्जित (निबन्ध, कविता र चुट्किलादेखि कम्प्युटर कोडसम्मका) लेख र (रेखाचित्र, तस्बिरहरू र कलाकृतिजस्ता) चित्रहरू मान्छेको रचनाबाट केकति फरक छन् भनेर सहजै खुट्ट्याउन सकिँदैन ।

तिनलाई विद्यार्थीहरूले गृहकार्य लेख्नदेखि राजनीतिज्ञहरूले भाषणहरू लेख्नसम्म पनि प्रयोग गरेका छन्। डेमोक्रेटिक नेता जेक असिनक्लोसले अमेरिकी संसद्मा उक्त प्रविधि प्रयोग गर्न थालेका थिए ।

प्रविधिसम्बन्धी प्रसिद्ध कम्पनी आईबीएमले आफ्ना ७,८०० पदमा मानिसलाई भर्ती गर्न बन्द गर्ने र ती काम एआईद्वारा गर्ने बताएको छ ।

यदि यी सबै परिवर्तनहरूले तपाईँलाई अत्यास लगाउँछन् भने निम्नलिखित अवस्थाका लागि आफैँलाई तयार गर्नुहोस्।

हामी एआईको पहिलो चरणमा मात्र छौँ। यसका अझै दुई वटा चरणहरू आउन बाँकी छन्, जसले मानव अस्तित्वलाई खतरामा पार्ने केही वैज्ञानिकहरूको अनुमान छ ।

यहाँ ती तीन चरणहरूको व्याख्या गरिएको छ ।

१. न्यारो आर्टिफिशल इन्टेलिजन्स (एनएआई)

न्यारो एआई अथवा एनएआई निर्धारित दायराभित्र दोहोरिने कामहरू गर्दै एउटा कार्यमा केन्द्रित हुन्छ ।

यसले सामान्यतया इन्टरनेटलगायत विभिन्न स्रोतबाट डेटा लिन्छ र आफैँलाई प्रशिक्षित गर्छ । तर उसले लिने जानकारीहरू विशेष क्षेत्रको मात्र हुन्छ ।

उदाहरणका लागि, एआई एक चेस प्रोग्रामले चेसको विश्वविजेतालाई हराउन सक्छ, तर त्योबाहेक अन्य कार्य गर्न सक्दैन ।

स्मार्टफोनहरूमा पनि यस्तो प्रविधि प्रयोग गर्ने थुप्रै एपहरू छन् – जीपीएस प्रणालीमा आधारित नक्सादेखि सङ्गीत र भिडिओ प्रोग्रामहरू प्रशस्त छन् जसले तपाईँको रुचि थाहा पाउँछन् र विभिन्न उपयुक्त सामग्री वा नतिजाहरू सिफारिस गर्छन् ।

चालकरहित कार र च्याटजीपीटीजस्ता परिष्कृत प्रणालीहरू पनि न्यारो एआईका प्रकार हुन् । तिनले निर्धारित भूमिकाहरूको दायराबाहिर काम गर्न सक्दैनन्। त्यसैले तिनीहरू आफैँ निर्णय गर्न सक्दैनन् ।

यद्यपि केही विज्ञहरूले च्याटजीपीटी वा अटोजीपीटीजस्ता स्वचालित रूपमा जानकारी लिने प्रणालीहरू विकासको अर्को चरणमा जान सक्ने ठानेका छन् ।

२. आर्टिफिशल जेनरल इन्टेलिजन्स (एजीआई)

कुनै उपकरणले मानिसले गर्न सक्ने तहको कुनै पनि बौद्धिक कार्य गर्न अवस्थामा आर्टिफिशल जेनरल इन्टेलिजन्सको चरणमा पुगिन्छ।

यसलाई ‘बलियो एआई’ पनि भनिन्छ ।

छ महिनाको विश्राम

सन् २०२२ को मार्चमा १,००० भन्दा बढी प्रविधिविज्ञहरूले “सबै एआई ल्याबहरूलाई तत्काल कम्तीमा छ महिनाका लागि च्याटजीपीटीको नवीनतम संस्करण जीपीटी-४ भन्दा शक्तिशाली एआई प्रणालीहरूको प्रशिक्षण रोक्न” आह्वान गरेका थिए ।

‘मान्छेको प्रतिस्पर्धी बनेको एआईले समाज र मानवतामा गहिरो जोखिम निम्त्याउन सक्छ,’ एपलका सहसंस्थापक स्टीभ ओज्निआकसँगै टेस्ला र स्पेसएक्सका मालिक इलन मस्कलगायत अन्य प्रविधि पैरवीकर्ताहरूले भनेका थिए ।

मस्क ओपनएआईका सहसंस्थापकहरूमध्ये एक थिए। पछि उक्त कम्पनीको नेतृत्वमा रहेका अन्यसँग असहमतिका कारण उनले त्यहाँबाट राजीनामा दिए ।

गैरनाफामुखी संस्था फ्यूचर अफ लाइफ इन्स्टिट्यूटले प्रकाशित गरेको एक विज्ञप्तिमा विज्ञहरूले, यदि कम्पनीहरूले आफ्ना परियोजनाहरू तत्काल नरोकेमा त्यसका लागि सरकारहरूले कदम चाल्नुपर्ने र केही समयका लागि एआईको गतिविधि रोक्नुपर्ने उल्लेख गरेका थिए ।

त्यस अवधिमा उपयुक्त सुरक्षा उपायहरू तयार गर्न र कार्यान्वयन गर्न सकिने उनीहरूले बताएका थिए ।

‘जति तीक्ष्ण त्यति मूर्ख’

अक्सफर्ड यूनिभर्सिटीको एआई इन्स्टिट्यूट फर एथिक्सकी करिसा भेलिजले पनि उक्त पत्रमा हस्ताक्षर गरेकी थिइन् ।

तर पछि उनले सेन्टर फर एआई सेफ्टीले दिएको ‘मानवजाति लोप हुने चेतावनी’ हदभन्दा पर गएको ठानिन् र त्यसमा भने हस्ताक्षर गरिनन् ।

उनले बीबीसीका एन्ड्रू वेबलाई भनिन्, ‘हामीले अहिले जुन प्रकारको एआई निर्माण गरिरहेका छौँ त्यो जति तीक्ष्ण छ त्यति नै मूर्ख पनि छ ।’

‘यदि कसैले च्याटजीपीटी वा अन्य एआईहरूको प्रयोग गरेका छन् भने उनीहरूलाई त्यस्ता प्रविधिको सीमाहरू थाहा हुने छ।’

एआईले ठूलो सङ्ख्यामा गलत जानकारी उत्पादन गर्न सक्नेबारे पनि उनी चिन्तित छिन्।

‘सन् २०२४ मा अमेरिकामा चुनाव हुँदै छ र ट्विटरलगायत अन्य महत्त्वपूर्ण सञ्जालहरूले आफ्नो एआई नीति तथा सुरक्षा टोलीहरू हटाइरहेका छन् । म यसबारे धेरै चिन्तित छु।’

अमेरिकी सरकारले पनि सम्भावित खतराहरू स्वीकार गरेको छ।

‘एआई हाम्रो समयको सर्वाधिक शक्तिशाली प्रविधिहरूमध्ये एक हो। तर यसले प्रदान गर्ने अवसरहरूको सही प्रयोग गर्नुपूर्व हामीले यसका जोखिमहरू कम गर्नुपर्छ,’ अमेरिकी राष्ट्रपति कार्यालयले मे ४ मा एक विज्ञप्तिमार्फत् भनेको थियो ।

अमेरिकी संसद्ले ओपनएआईका प्रमुख कार्यकारी अधिकृत साम अल्टम्यानलाई च्याटजीपीटीबारे सुनुवाइका लागि बोलाएको थियो ।

माथिल्लो सदनको सुनुवाइका क्रममा अल्टम्यानले शक्ति बढाउँदै गएको एआई उद्योगलाई सरकारले नियमन गर्नु अत्यावश्यक भएको बताएका थिए।

फ्यूचर अफ लाइफ इन्स्टिट्यूटका सार्वजनिक नीति अनुसन्धानकर्ता कार्लोस इग्नासियो गुटेरेसले जलवायु परिवर्तनसम्बन्धी मामिला हेर्न आईपीसीसीजस्तो अन्तरसरकारी निकाय भएजस्तै एआईलाई कसरी नियमन गर्ने भन्ने निर्णय गर्ने विज्ञहरूको कुनै निकाय नहुनु मुख्य चुनौती भएको बताए ।

त्यस चुनौतीले हामीलाई एआईको तेस्रो र अन्तिम चरणमा पुर्याउँछ ।

३. आर्टिफिशल सुपर इन्टेलिजन्स (एएसआई)

हामी दोस्रो चरण (एजीआई) पुगेको अवस्थामा अकस्मात् एआईको तेस्रो चरण अर्थात् आर्टिफिशल सुपर इन्टेलिजन्स (एएसआई)मा पुगिन्छ भन्ने विचार एआईको तेस्रो चरणको सिद्धान्त हो । आर्टिफिशल इन्टेलिज१२न्स मानव बुद्धिमत्ताको तुलनामा उच्च स्तरको हुने अवस्थामा यो चरण सुरु हुन्छ ।

अक्सफर्ड यूनिभर्सिटीका दार्शनिक तथा एआई विज्ञ निक बोस्ट्रम एएसआईलाई त्यस्तो बौद्धिकताका रूपमा व्याख्या गर्छन् जसले वैज्ञानिक रचनात्मकता, सामान्य बौद्धिकता र सामाजिक सीपलगायत व्यावहारिक रूपमा हरेक क्षेत्रहरूमा मानव मस्तिष्कको तुलनामा निकै उत्कृष्ट प्रदर्शन गर्छ।

‘इन्जिनियर, नर्स वा वकिल बन्न मानिसहरूले निकै समय अध्ययन गर्नुपर्छ। तर एजीआईको हकमा [सम्भव भएसम्म] यसले हामी मानवले भन्दा निकै कम समयमा अनवरत रूपमा आफूलाई सुधार्न सक्छ’ गुटेरेस व्याख्या गर्छन्।

साइन्स फिक्शन

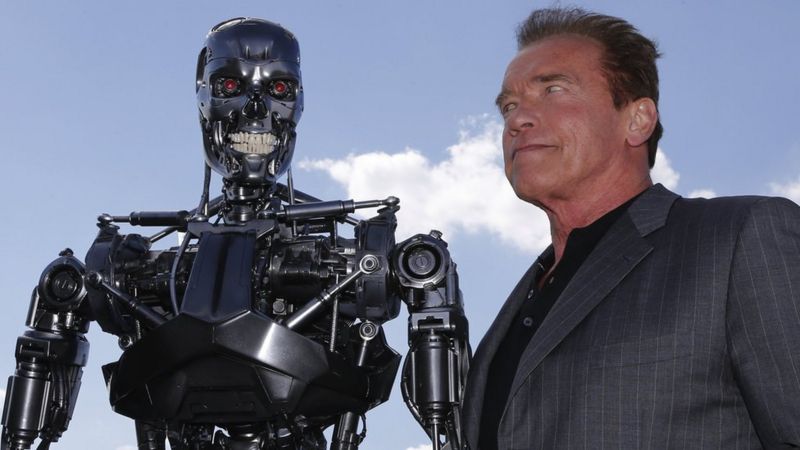

यो विचारले ‘द टर्मिनेटर’ चलचित्रको कथा झल्काउँछ ।

त्यस कथामा मशीनहरूले मानवजाति उन्मूलन गर्ने उद्देश्यले पारमाणविक युद्ध सुरु गर्छन् ।

प्रिन्सटन यूनिभर्सिटीका का कम्प्युटर वैज्ञानिक अरविन्द नारायणनले साइन्स फिक्शनमा आधारित चलचित्रमा देखाइने विध्वंशका परिवेशहरू अवास्तविक हुने बताएका थिए।

‘एआईको वर्तमान अवस्था त्यस्तो जोखिम निम्त्याउन सक्नेगरी सक्षमतासँग कत्ति पनि नजिक छैन। फलस्वरूप यसले निकट भविष्यमा एआईले ल्याउन सक्ने सम्भावित हानिहरूबाट ध्यान हटाएको छ।’

विशेषतः भावनात्मक बौद्धिकताको सन्दर्भमा मानवजस्तै व्यापक बुद्धिमत्ताको स्तर हासिल गर्न मशीनहरू सक्षम छन् वा छैनन् भन्ने विषयमा निकै बहस भएका छन्।

यो चिन्ता विशेष गरी हामी एजीआई प्राप्तिको नजिक छौँ भन्ने दृढ विश्वास गर्नेहरूमा अधिक छ ।

केही समयअघि बीबीसीसँगको एक अन्तर्वार्तामा आर्टिफिशल इन्टेलिजन्सको क्षेत्रमा प्रख्यात व्यक्तित्व र आर्टिफिशल इन्टेलिजन्सका गडफादरका रूपमा प्रसिद्ध जिओफ्री हिन्टनले हामी उक्त ‘कोसेढुङ्गाको नजिकै’ हुनसक्ने चेतावनी दिए ।

हिन्टन मशीनहरूलाई अनुभवका आधारमा प्रशिक्षण गर्ने कामका लागि परिचित छन् ।

‘जहाँसम्म मलाई लाग्छ अहिले मशीनहरू हामीभन्दा बुद्धिमान् छैनन्। यद्यपि छिट्टै उनीहरू हामीभन्दा बुद्धिमान् हुने छन् भन्ने मलाई लाग्छ,’ गुगलबाट भर्खरै अवकाशप्राप्त ७५ वर्षीय उनले भने।

गुगलबाट आफ्नो बहिर्गमनको घोषणा गर्न न्यूयोर्क टाइम्सलाई पठाइएको एक वक्तव्यमा हिन्टनले आफ्नो विगतका कार्यहरूका लागि पश्चात्ताप व्यक्त गरे किनकि उनी “खराब काम गर्नेहरू”ले एआईको प्रयोग गरेर “दुष्कर्म” गर्नेप्रति चिन्तित थिए।

बीबीसीसँगको एक अन्तर्वार्ताको क्रममा उनले एउटा ‘दुःस्वप्न परिदृश्य’ को वर्णन गरे।

‘मानौँ रुसी राष्ट्रपति भ्लादिमिर पुटिन जस्ता खराब काम गर्ने व्यक्तिले रोबटहरूलाई आफ्नै सहायक लक्ष्यहरू उत्पन्न गर्ने क्षमता प्रदान गर्यो भने त्यसले अप्रत्याशित परिणामहरू निम्त्याउन सक्छ।’

यी मशीनहरूले अन्ततः ‘मलाई थप शक्ति प्राप्त गर्न आवश्यक छ’ भन्ने जस्ता सहायक लक्ष्यहरू सिर्जना गर्न सक्ने सम्भावना औँल्याउँदै ‘अस्तित्व सङ्कट’मा पर्न सक्ने चेतावनी उनले दिए।

तर हिन्टनले छोटो अवधिमा एआईले जोखिमको तुलनामा धेरै फाइदाहरू प्रदान गर्ने आफूले सोचेको बताए।

‘त्यसैले मलाई हामीले यो प्रविधिको विकास गर्न बन्द गर्नुपर्छ जस्तो लाग्दैन,’ उनले थपे।

लोप वा अमरत्व

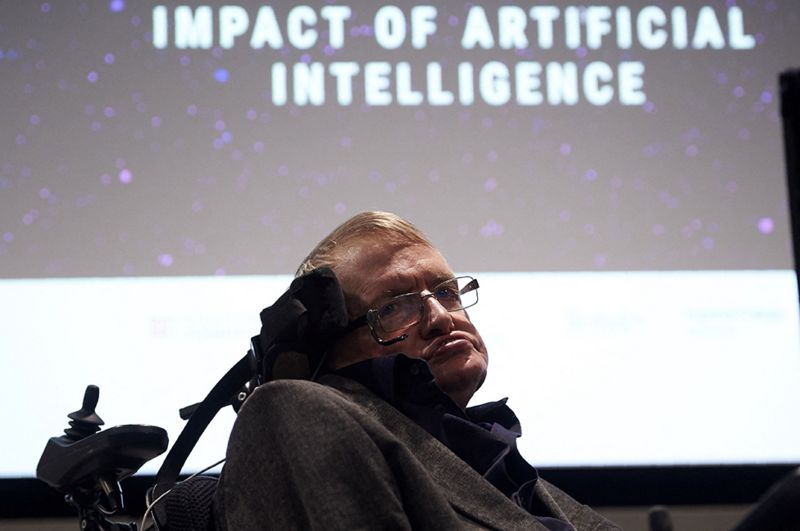

यसबारे बेलायती भौतिकशास्त्री स्टीभन हकिङले कडा चेतावनी दिएका थिए ।

‘पूर्ण आर्टिफिशल इन्टेलिजन्स विकास हुनुको अर्थ मानवजातिको अन्त्य हुन सक्छ,’ उनले आफ्नो मृत्यु हुनुभन्दा चार वर्षअघि २०१४ मा बीबीसीलाई दिएको अन्तर्वार्तामा भनेका थिए।

यस स्तरको बुद्धिमत्ता भएको मशीनले ‘आफैँ निर्णय गर्दै निकै तीव्र दरमा आफैलाई पुन: परिमार्जित गर्ने छ,’ उनले भनेका थिए।

एआईबारे सबैभन्दा उत्साहित भविष्यवादी आविष्कारक तथा लेखक रे कुर्जवेल हुन्।

गुगलमा एआई अनुसन्धाताका रूपमा कार्यरत उनी सिलिकन भ्यालीस्थित सिन्ग्यल्यारिटी यूनिभर्सिटीका सहसंस्थापक हुन् ।

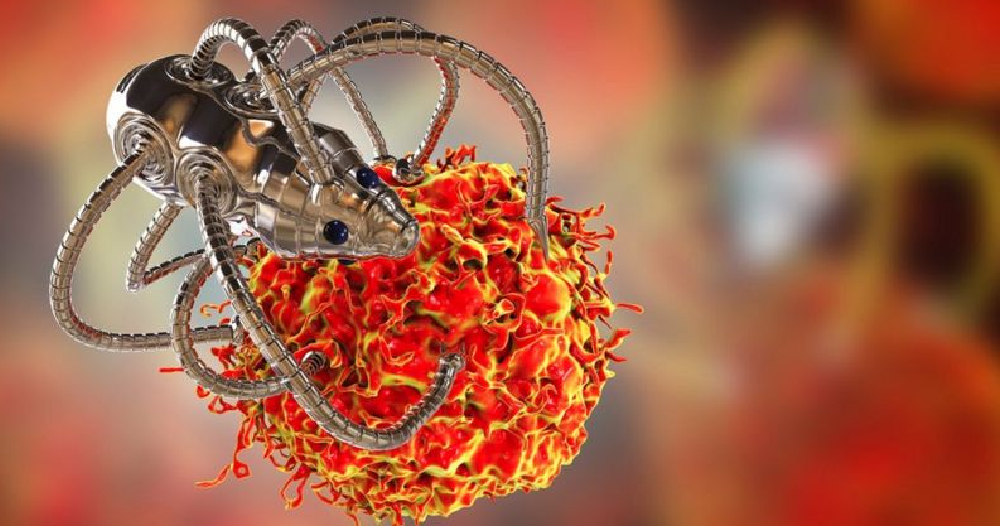

न्यानोबट र अमरत्व

कुर्ज्वेल मानिसहरू निकै नै बुद्धिमान् एआईको प्रयोग गरेर जैविक अवरोधहरू पार गर्न सक्षम हुने कुरामा विश्वास गर्छन्।

सन् २०१५ मा उनले २०३० सम्ममा मानिसहरूले न्यानोबट (अतिसूक्ष्म रोबट)को प्रयोगमार्फत् अमरत्व हासिल गर्न सक्ने भनेर भविष्यवाणी गरेका थिए ।

यी न्यानोबटहरू हाम्रो शरीरभित्र अवस्थित हुन्छन् र आफैँ चोटपटक वा रोग निको पार्छन् ।

एआई शासन

गुटेरेस एआई शासन प्रणालीको निर्माण गर्नु महत्त्वपूर्ण रहेको कुरामा सहमत छन्।

‘एउटा यस्तो भविष्यको कल्पना गर्नुहोस् जहाँ कुनै निकायसँग प्रत्येक व्यक्ति र तिनको बानीबारे यति धेरै जानकारी छ कि त्यसले हामीलाई थाहा नहुने तरिकामा नियन्त्रण गर्न सक्छ,’ उनले भने।

‘मानव र रोबटबीचको युद्ध सबैभन्दा नराम्रो अवस्था होइन। बरु हामीले आफूमाथि नियन्त्रण भएको महसुस नगर्नु सबैभन्दा नराम्रो अवस्था हो ।’

‘किनकि हामी आफूभन्दा निकै बुद्धिशाली तत्त्वसँग सगोलमा बस्दै छौँ ।’ –BBC

प्रतिक्रिया